DeepSeek-V4发布百万上下文与1.6T参数Pro版模型

DeepSeek-V4预览版系列正式发布,包含1.6T参数的Pro版与284B参数的Flash版,两款模型均支持一百万tokens的超长上下文长度。这一消息来自HyperAI超神经的论文摘要及官方使用入口页面,标志着该系列在长文本处理与高效推理上迈出了实质性一步。

Pro版参数规模与架构升级

DeepSeek-V4-Pro拥有1.6T总参数,激活参数为49B,采用Mixture-of-Experts(MoE)架构。它结合了压缩稀疏注意力机制,这确实是个挺大的技术亮点——能在处理百万级上下文时大幅降低计算开销。官方数据显示,其推理FLOPs消耗降低了27%,KV Cache占用减少了10%。

Flash版轻量化与实用场景

DeepSeek-V4-Flash则更轻巧,284B总参数、13B激活参数,同样支持1M上下文。它更适合处理长文档、代码仓库和多步骤推理任务。没错,对于需要快速响应的工程场景,Flash版算是提供了一个高效选择。

强化学习赋能的推理引擎

DeepSeek-V4系列彻底告别了“鹦鹉学舌”式的生成模式。通过独特的推理决策模块,模型能自主进行多步逻辑推导,在数学难题、编程复杂架构和管理决策上表现出极强的原创思维能力。凭什么说它只是简单模仿?从官方公布的强化学习训练路径看,它确实具备了深层推理能力。

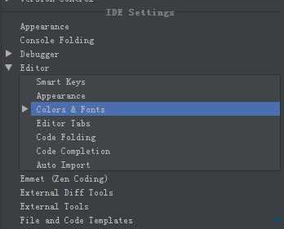

实际应用与接入方式

在工业级代码生成与调试上,DeepSeek-V4不只是补全代码,更能阅读工程上下文、理解跨文件依赖、辅助重构。顶尖级数学推理能力也让它在复杂逻辑问题上表现突出。用户可通过七牛云AI等官方渠道免费领取300万Token进行体验,这挺适合开发者快速上手测试。

技术矩阵与未来影响

DeepSeek-V4的核心技术矩阵包括混合注意力机制与多阶段能力整合。它打破了算力枷锁,以硬核算法实现在复杂推理、长文本理解和工程执行上的全面进阶。1M超长上下文支持一次处理更长的代码、合同、研究资料和知识库内容,减少来回切分上下文带来的理解损失。这确实是个挺大的进步!