DeepSeek-V4发布:百万上下文国产开源模型比肩闭源巨头

DeepSeek今天正式发布新一代大模型DeepSeek-V4预览版并同步开源,直接对标顶级闭源模型。这次一口气推出两个版本:DeepSeek-V4-Pro拥有1.6T参数、49B激活,上下文长度达到1M;DeepSeek-V4-Flash则是284B参数、13B激活的经济版,同样支持百万上下文。官方直言,在Agent能力、世界知识和推理性能上均实现国内与开源领域的领先。

百万上下文成为标配,成本大幅降低

DeepSeek-V4支持100万token上下文,相当于能一次性处理数十万字的文档。这确实是个挺有意思的突破——它采用创新注意力机制,把长文本处理的计算成本降了下来。咱们想想,以前处理长文档要么分段要么截断,现在直接整篇喂进去,效率能提升多少?

Agent能力专项升级,代码交付接近Opus 4.6

这次DeepSeek-V4针对Claude Code、OpenClaw等主流Agent框架做了深度优化。内部测试中,代码交付质量已经接近Opus 4.6的水平。凭什么说它比肩闭源巨头?就凭这个Agent能力,在国产开源模型里算是头一遭。可以说,DeepSeek-V4在Agent场景下的表现,已经让开源阵营有了跟闭源掰手腕的底气。

双版本策略覆盖不同需求

V4-Pro对标顶级闭源模型,适合对性能要求极高的场景;V4-Flash则更轻量、更经济,提供快速响应的API服务。这种双版本打法挺聪明——高端用户要性能,普通用户要性价比,DeepSeek一把全包了。而且两个版本都开源,开发者可以自由部署和二次开发。

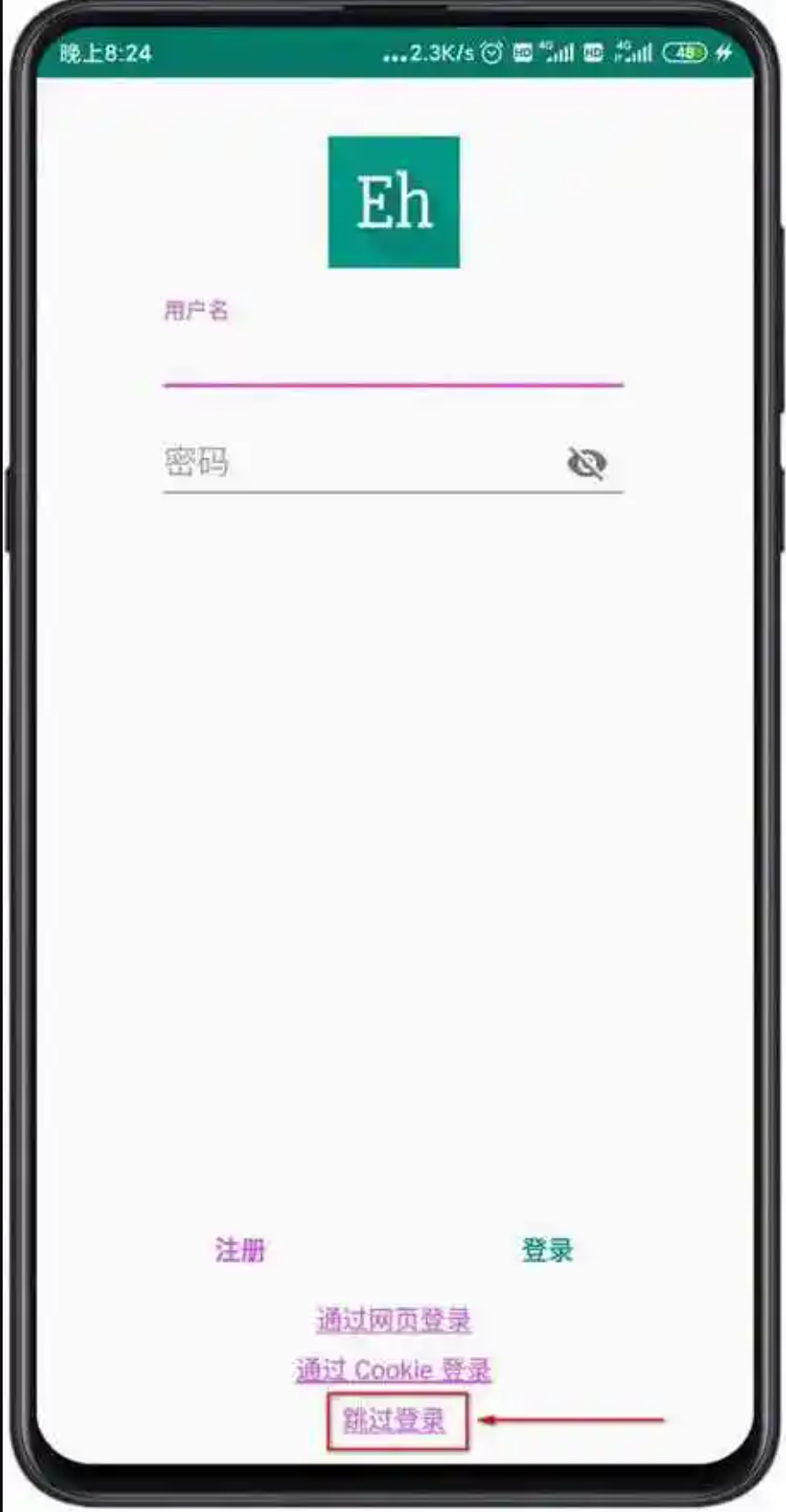

如何体验?官方渠道已开放

想试试的朋友,可以直接登录chat.deepseek.com或官方App在线体验。API调用的话,把model_name更新为deepseek-v4-pr开头就行。DeepSeek团队在文末写道:“不诱于誉,不恐于诽,率道而行,端然正己。”这话说得挺实在,开源模型走到这一步,确实不容易。

百万上下文普惠时代真的来了!国产开源模型首次在核心能力上比肩顶级闭源,这背后是华为芯片的深度合作。DeepSeek-V4的发布,意味着咱们在AI基础设施上又多了一个靠谱的选择。