AI Agent长期记忆实现教程:从短期到长期架构实践

作者:袖梨

2026-05-15

AI Agent长期记忆实现教程:从短期到长期架构实践

长期记忆的实现核心在于:上下文是有限的,你不可能把用户所有历史都塞进LLM的上下文窗口中。记忆必须是动态检索的,将短期上下文与长期情景记忆(事件)和语义记忆(事实)分开存储。这就引出了咱们今天要动手实践的核心思路。

第一步:理解记忆类型:先理解Agent内存的三大类型。短期记忆就是当前对话的上下文窗口,长期记忆则分为情景记忆(记录发生了什么)和语义记忆(记录什么是事实)。可执行动作:在项目中明确区分两类长期记忆的存储结构,比如用不同的表或集合来存“事件”和“事实”。

实现长期记忆:第二步,把短期对话中的关键信息提取出来,存入向量数据库。可执行动作:每次对话结束后,用LLM提取摘要或关键事实,生成向量并存入数据库。下次对话时,根据当前输入检索相关记忆,拼入上下文。这确实解决了大海捞针问题——信息在中间时最难找到,但动态检索能精准命中。

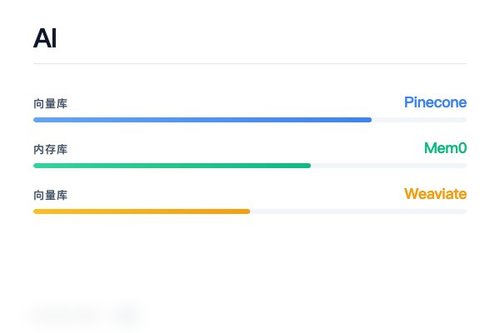

工具选型:第三步,选择专业工具。你可以用向量数据库(如Pinecone、Weaviate)自己搭建,也可以直接用Mem0或Zep这类专门为Agent设计的内存管理库。可执行动作:尝试用Mem0的API,它自动处理了情景与语义的分离和检索。为什么非要分开存?因为情景记忆会随时间衰减,而语义记忆需要长期保留,混在一起检索效率反而低。

总结要点:长期记忆不是把历史全塞进去,而是动态检索。记住三个动作:区分——短期与语义记忆,用短期上下文处理当前对话,用情景记忆记录事件,用语义记忆存储事实。工具方面,向量数据库或Mem0都能帮你快速落地。这就完成了从短期到长期架构的实践!